La combinación del primer marco jurídico sobre la IA de la historia y de un nuevo plan coordinado con los Estados miembros garantizará la seguridad y los derechos fundamentales de las personas y las empresas, al tiempo que reforzará la adopción, la inversión y la innovación en materia de IA en toda la UE. Complementarán este enfoque las nuevas normas sobre maquinaria, que adaptarán las normas de seguridad para dar mayor confianza a los usuarios en la nueva y versátil generación de productos.

El nuevo Reglamento sobre la Inteligencia Artificial garantizará que los europeos puedan confiar en lo que la IA puede ofrecer. Unas normas proporcionadas y flexibles abordarán los riesgos específicos que plantean los sistemas de IA y fijarán los estándares más altos del mundo.

El plan coordinado expone los cambios de política y las inversiones necesarios en los Estados miembros para reforzar el liderazgo de Europa en el fomento de una IA centrada en el ser humano, sostenible, segura, inclusiva y fiable.

El planteamiento europeo sobre una IA fiable

Las nuevas normas se aplicarán directamente de la misma manera en todos los Estados miembros sobre la base de una definición de IA a prueba de futuro. Siguen un planteamiento basado en el riesgo, como se explica a continuación.

Riesgo inadmisible: Se prohibirán los sistemas de IA que se consideren una clara amenaza para la seguridad, los medios de subsistencia y los derechos de las personas. Esto abarca los sistemas o las aplicaciones de IA que manipulan el comportamiento humano para eludir la voluntad de los usuarios (por ejemplo, juguetes que utilicen asistencia vocal para incitar a comportamientos peligrosos a los menores) y sistemas que permitan la «puntuación social» por parte de los Gobiernos.

Alto riesgo: Los sistemas de IA considerados de alto riesgo abarcan las tecnologías de IA empleadas en:

- infraestructuras críticas (por ejemplo, transportes), que pueden poner en peligro la vida y la salud de los ciudadanos;

- formación educativa o profesional, que pueden determinar el acceso a la educación y la carrera profesional de una persona (por ejemplo, puntuación en exámenes);

- componentes de seguridad de los productos (por ejemplo, aplicación de IA en cirugía asistida por robots);

- empleo, gestión de trabajadores y acceso al trabajo por cuenta propia (por ejemplo, programas informáticos de clasificación de CV para procedimientos de contratación);

- servicios públicos y privados esenciales (por ejemplo, sistemas de calificación crediticia que priven a los ciudadanos de la oportunidad de obtener un prestamo);

- aplicación de las leyes, que pueden interferir con los derechos fundamentales de las personas (por ejemplo, evaluación de la fiabilidad de las pruebas);

- gestión de la migración, el asilo y el control de las fronteras (por ejemplo, comprobación de la autenticidad de los documentos de viaje);

- administración de justicia y procesos democráticos (por ejemplo, aplicación de la ley a un conjunto concreto de hechos).

Los sistemas de IA de alto riesgo estarán sujetos a obligaciones estrictas antes de que puedan comercializarse:

- sistemas adecuados de evaluación y mitigación de riesgos;

- alta calidad de los conjuntos de datos que alimentan el sistema para minimizar los riesgos y los resultados discriminatorios;

- registro de la actividad para garantizar la trazabilidad de los resultados;

- documentación detallada que aporte toda la información necesaria sobre el sistema y su finalidad para que las autoridades evalúen su conformidad;

- información clara y adecuada al usuario;

- medidas apropiadas de supervisión humana para minimizar el riesgo;

- alto nivel de solidez, seguridad y precisión.

En especial, se consideran de alto riesgo y estarán sujetos a requisitos estrictos todos los sistemas de identificación biométrica remota. Su uso en directo en espacios de acceso público con fines policiales está prohibido en principio. Se definen y regulan estrictamente excepciones estrictas (por ejemplo, cuando sea estrictamente necesario para la búsqueda de un menor desaparecido, para prevenir una amenaza terrorista concreta e inminente, o para detectar, localizar, identificar o enjuiciar a un autor o sospechoso de un delito grave). Su uso estará sujeto a la autorización de un órgano judicial u otro organismo independiente y a los límites adecuados desde el punto de vista de la duración, el alcance geográfico y las bases de datos exploradas.

Riesgo limitado, es decir, sistemas de IA con obligaciones específicas de transparencia: Al utilizar sistemas de IA como robots conversacionales, los usuarios deberán ser conscientes de que están interactuando con una máquina para poder tomar una decisión informada de continuar o no.

Riesgo mínimo o nulo: La propuesta permite el uso gratuito de aplicaciones tales como videojuegos basados en la IA o filtros de correo basura. La inmensa mayoría de los sistemas de IA entra en esta categoría. El proyecto de Reglamento no interviene aquí, ya que estos sistemas de IA solo representan un riesgo mínimo o nulo para los derechos o la seguridad de los ciudadanos.

En términos de gobernanza, la Comisión propone que las autoridades nacionales de vigilancia del mercado controlen las nuevas normas, mientras que la creación de un Comité Europeo de Inteligencia Artificial facilitará su aplicación e impulsará la creación de normas en materia de IA. Además, se proponen códigos de conducta voluntarios para la IA que no entrañe un alto riesgo, así como espacios controlados de pruebas para facilitar la innovación responsable.

El planteamiento europeo sobre la excelencia en materia de IA

La coordinación reforzará el liderazgo de Europa en materia de IA centrada en el ser humano, sostenible, segura, inclusiva y fiable. Para que Europa siga siendo competitiva a escala mundial, la Comisión se ha comprometido a fomentar la innovación en el desarrollo y uso de la tecnología de IA en todos los sectores y en todos los Estados miembros.

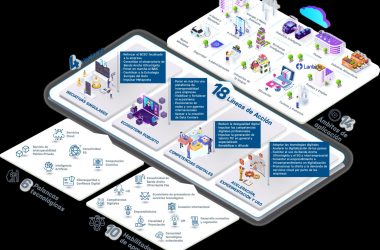

Publicado por primera vez en 2018 para definir medidas e instrumentos de financiación para el desarrollo y la adopción de la IA, el plan coordinado sobre la IA facilitó una gran variedad de estrategias nacionales y fondos de la UE para asociaciones público-privadas y redes de investigación e innovación. La actualización exhaustiva del plan coordinado propone actuaciones conjuntas concretas de colaboración para velar por que todos los esfuerzos estén en consonancia con la Estrategia Europea sobre la IA y el Pacto Verde Europeo, teniendo en cuenta al mismo tiempo los nuevos retos que plantea la pandemia de coronavirus. Presenta un plan para acelerar las inversiones en IA, lo que puede redundar en beneficio de la recuperación. También persigue estimular la ejecución de las estrategias nacionales de IA, eliminar la fragmentación y hacer frente a los retos mundiales.

El plan coordinado actualizado empleará la financiación asignada con cargo a los programas Europa Digital y Horizonte Europa, así como al Mecanismo de Recuperación y Resiliencia, que prevé un objetivo de gasto digital del 20 %, y a la Política de Cohesión con los fines siguientes:

- crear las condiciones propicias para el desarrollo y la implantación de la IA mediante el intercambio de información estratégica y de datos, y la inversión en capacidades informáticas críticas;

- fomentar la excelencia de la IA «del laboratorio al mercado» mediante la creación de una asociación público-privada, la creación y movilización de capacidades de investigación, desarrollo e innovación, y la puesta a disposición de las pymes y las Administraciones públicas de instalaciones de ensayo y experimentación, así como de centros de innovación digital;

- velar por que la IA sirva a las personas y sea una fuerza en pro del bien social, situándose en la vanguardia del desarrollo y el despliegue de una IA fiable, fomentando talentos y capacidades mediante el apoyo a los períodos de prácticas, las redes de doctorado y las becas postdoctorales en ámbitos digitales, integrando la confianza en las políticas en materia de IA y promoviendo la visión europea de una IA sostenible y fiable a escala mundial;

- fomentar el liderazgo estratégico en sectores y tecnologías de gran impacto, tales como el medio ambiente, centrándose en la contribución de la IA a la producción sostenible, la salud mediante la ampliación del intercambio transfronterizo de información, así como el sector público, la movilidad, los asuntos de interior y la agricultura, además de la robótica.

El planteamiento europeo sobre la nueva maquinaria

La maquinaria abarca una amplia gama de productos de consumo y profesionales, desde robots hasta cortadoras de césped, impresoras 3D, máquinas de construcción y líneas de producción industrial. La Directiva sobre máquinas, sustituida por el nuevo Reglamento sobre máquinas, definió los requisitos sanitarios y seguridad de las máquinas. Este nuevo Reglamento sobre máquinas velará por que la nueva generación de maquinaria garantice la seguridad de los usuarios y consumidores, y fomentará la innovación. Mientras que el nuevo Reglamento sobre la IA abordará los riesgos de seguridad de los sistemas de IA, el Reglamento sobre máquinas garantizará la integración segura de los sistemas de IA en la maquinaria en general. Las empresas solo tendrán que realizar una única evaluación de la conformidad.

Además, el nuevo Reglamento sobre máquinas responderá a las necesidades del mercado al aportar mayor claridad jurídica a las disposiciones actuales, simplificar la carga administrativa y los costes para las empresas mediante la autorización de formatos digitales para la documentación y adaptar las tasas de evaluación de la conformidad para las pymes, sin descuidar por ello la coherencia con la normativa de la UE en materia de productos.